누누티비 카지노시즌2|토토사이트 순위 디시

누누티비 카지노시즌2

토토사이트 추천 디시, Inc

누누티비 카지노시즌2

【지금 확인】전문가 견해: 🌈누누티비 카지노시즌2 🌈에 대한 최신 통찰력과 업계에서 카지노 시즌2 4의 위치. 권위 있는 분석!

한동안 구글은 인공지능(AI) 경쟁에서‘뒤처진 공룡’으로 불렸다.대표적 사례가‘바드 굴욕’이다.2022년 말 오픈AI 챗GPT가 출시되자 마음 급해진 구글은 2023년 2월 AI 챗봇 바드를 공개했다.하지만 혹평이 잇따랐다.순다르 피차이 구글 최고경영자(CEO)가 참석한 바드 시연회에서도 오답을 내놓아 망신만 당했다.당시 언론들은 “구글 바드는 오픈AI의 챗GPT만큼 학습 도구로서의 능력은 없는 것 같다”며 “AI 전쟁의 패배자”라고 비판했다.하지만 겉으로 보이는 모습이 전부는 아니었다.내부에선‘레드 코드’를 선언하고 AI 시장 대응을 이어갔다.특히 AI 칩 부문에 집중했다.구글은 2016년부터 자체 AI 전용 칩 TPU(텐서 처리 장치) 개발에 나섰다.

첫 세대부터‘딥러닝에 최적화된 특수 목적 칩’이라는 방향을 잡았다.이후 세대마다‘연산 효율’과‘확장성’에 초점을 맞췄다.엔비디아 컴퓨터그래픽장치(GPU)의 AI 칩 시장 독점에도 구글은 TPU 생태계를 포기하지 않았다.이 과정에서 탄생한 게 지난 10월 발표된 제미나이 3다.

LM아레나 리더보드에서 1501점을 기록해 1위를 차지한 제미나이 3는 TPU v7(아이언우드) 기반으로 데이터 학습(Learning)과 추론(Inference) 작업이 이뤄졌다‘바드 굴욕’2년 반 만에 본인들의 존재감을 다시 드러낸 셈이다.기대 이상의 성능에 일각에선 TPU가 엔비디아 패권 균열의 시작점이 될 수 있다는 평가들이 쏟아졌다.

엔비디아도 구글 TPU 성과를 두고 모호한 감정을 드러냈다.엔비디아는 11월 25일(현지 시각) 소셜미디어(SNS) 공식 계정에서 “구글의 성공에 기쁘고 구글은 AI 분야에서 큰 진전을 이뤘다”고 치켜세우면서도 “우리는 계속 구글에 제품을 공급하고 있다”고 밝혔다.그러면서 “우리는 업계보다 한 세대 앞서 있다”며 “모든 AI 모델을 구동하고 컴퓨팅이 이뤄지는 모든 곳에서 이를 수행하는 것은 우리 플랫폼뿐”이라고 강조했다.

내부용 넘어‘외부 판매용’으로

TPU v7(아이언우드) 주목 배경 중 하나는 전 세대 대비 크게 개선된 단일 칩 성능이다.외신 보도를 종합하면 아이언우드는 개별 칩 FP8(8비트) 기준 4614TFLOPS(테라플롭스) 연산 성능을 갖췄다고 추정된다.테라플롭스는 칩이 1초에 몇 조번 계산할 수 있느냐를 나타내는 단위다.가령,1테라플롭스라면 1초에 1조번 계산한다는 의미다.이는 직전 세대(V6)와 동일 기준 비교 시 4배 이상 개선된 수치다.물론 이는 경쟁사인 엔비디아 최신 GPU인 블랙웰(외신 추정 기준 5000~9000테라플롭스)에는 못 미치지만 전작인 H200(3958테라플롭스)보다는 높은 편이다.

더군다나 아이언우드는 가격 경쟁력이 확실하다.미래에셋증권에 따르면,아이언우드의 개당 비용은 약 1만5000달러 수준으로 예상된다.3만~4만달러를 호가하는 엔비디아 H100·H200의 절반 수준이다.반도체 분석 업체 세미애널리시스는 아이언우드와 블랙웰(GB200) 비용 효율 비교 보고서(TPU v7: Google Takes a Swing at the King)에서 “동일한 규모의 서버 구축을 가정할 때,아이언우드 연산량당 총소유비용(TCO)이 블랙웰 대비 44% 절감할 수 있다”고 설명했다.분명한 성능 차이는 있지만,누누티비 카지노시즌2이를 상쇄할 만한 가격 경쟁력이라는 의미다.

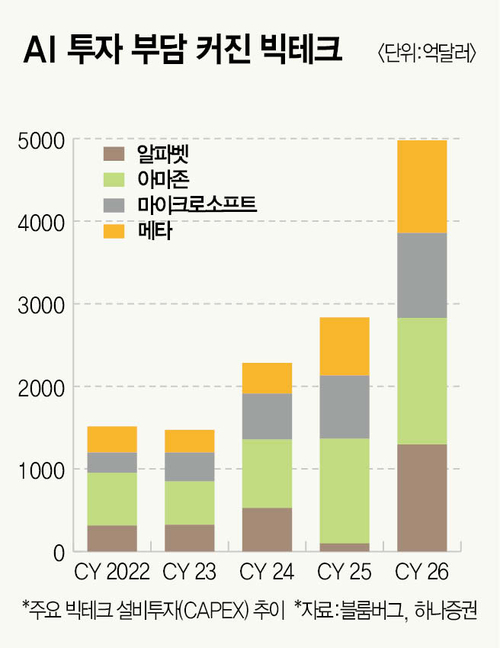

AI 데이터센터 등 인프라 구축을 위해 대규모 설비투자(CAPEX) 중인 빅테크 입장에선 매력적인 선택지다.키움증권에 따르면,주요 빅테크 4사(구글·메타·마이크로소프트·아마존)의 CAPEX는 2024년 2283억달러에서 2025년 3462억달러까지 늘어날 전망이다.2026년과 2027년 CAPEX 추정치도 각각 4021억달러,4343억달러다.

관련 업계는 빅테크의 CAPEX 확대 요인 중 하나로‘엔비디아 택스(NVIDIA Tax)’를 꼽는다.엔비디아가 시장에서 강력한 독점적 위치를 차지하다 보니,기업들이‘울며 겨자 먹기’로 비용을 지불 중이란 의미다.틀린 말이 아니다.AI 데이터센터 구축을 위해선 AI 칩이 필수다.문제는 엔비디아 GPU를 대체할 대안이 없다는 점이다.엔비디아가 아무리 비싼 가격을 불러도‘완판 행렬’이다.젠슨 황 엔비디아 CEO는 최근 실적설명회에서 “블랙웰 판매가 폭발적이고 클라우드 GPU는 완판 상태”라고 말했다.

빅테크 입장에서 아이언우드가 반가울 수밖에 없는 이유다.구글도 이 지점을 공략 중이다.당초 TPU는 내부 워크로드 처리를 위해 설계됐지만,아이언우드를 기점으로 외부 판매에 나섰다.관련 업계에 따르면,구글은 지난해 TPU 전담 세일즈 조직을 신설하고 GCP 고객사(구글 클라우드를 쓰는 고객사) 대상으로 아이언우드 사용을 권장 중이다.외신에 따르면,구글 내부에서는 본격적인 외부 판매를 통해 엔비디아 연간 매출의 약 10%를 확보할 수 있다고 기대 중이다.2025회계연도(2024년 2월~2025년 1월) 기준 엔비디아의 연간 매출은 1305억달러다.10%만 해도 연간 100억달러 이상이다.

기대감은 현실이 되고 있다.AI 모델‘클로드’를 개발한 앤트로픽은 지난 10월 아이언우드 100만개가 탑재된 클라우드 이용 계약을 체결했다.엔비디아 핵심 고객사로 꼽히던 메타도 달라진 분위기가 감지된다.미국 IT 전문 매체 디 인포메이션은 “메타가 오는 2027년 가동에 들어갈 데이터센터에 구글 TPU를 사용하는 방안을 검토 중”이라고 보도했다.

한종목 미래에셋증권 애널리스트는 “빅테크 업체들은 CAPEX가 지속 상향되면서 비용 부담이 가중되는 상황이었고,효율적인 투자에 대한 하나의 대안을 찾은 것”이라며 “TPU는 AI 학습에 필수적인 행렬 연산을 위한 낮은 정밀도 연산에 최적화돼 연산 속도와 전력 소모 측면에서 유리하다.앤트로픽과 메타 이슈는 AI 훈련용 칩을 제대로 만들 수 있는 회사가 사실상 엔비디아와 구글,양강 체제로 좁혀지고 있음을 시장에 각인시킨 사례”라고 설명했다.

칩 간 경쟁 아닌 시스템 경쟁

아이언우드의 진짜 경쟁력은‘시스템’이라는 말도 나온다.애초에 구글 목표가 엔비디아와‘칩 vs 칩’성능 경쟁이 아닌‘시스템 vs 시스템’경쟁이란 해석이다.제프 딘 구글 AI 수석 과학자는 “아이언우드의 핵심 경쟁력은 개별 칩이 아닌 9216개 칩을 결합해‘슈퍼팟(Superpod)’단위로 작동할 수 있도록 설계됐다는 점”이라고 강조했다.제프 딘이 언급한 슈퍼팟은 아이언우드 등 TPU를 수천개 연결해 하나의 거대한 컴퓨터처럼 만드는 구조를 말한다.쉽게 말해 기존 서버가‘개별 난방 시스템’이라면,슈퍼팟은 건물 전체 난방을 한 번에 제어하는‘중앙 난방 시스템’이다.이론상 최대 9216개 칩 결합이 가능하다는 게 구글 설명인 셈이다.슈퍼팟의 최대 장점은 효율성이다.수천 개 칩 사이에서 발생하는 통신 지연을 최소화하고‘올-리듀스(All-Reduce)’를 빠르게 처리할 수 있다.올-리듀스는 일종의 취합 기능이다.여러 칩이 계산한 결과를 모아서 하나로 만드는 과정이다.

증권가는 아이언우드 슈퍼팟이 현실화되면 엔비디아 중심의 AI 칩 시장 구도가 흔들릴 수 있다고 분석한다.미래에셋증권에 따르면,아이언우드 슈퍼팟은 FP8 기준 42.5엑사플롭스 성능이다.또 1.77페타바이트(PB) 규모의 공유 메모리를 제공한다.쉽게 말해 수천 개 칩이 하나의 초대형 메모장을 함께 쓰면서 동시에 계산하는 구조다.한종목 애널리스트는 “9216개의 칩이 1.77PB 메모리를 공유한다는 건 10조개가 넘는 파라미터를 가진 모델도 실시간으로 돌릴 수 있다는 뜻”이라며 “이론적으로는 100조 파라미터급 초거대 모델 학습도 가능해진다”고 설명했다.그러면서 “구글이 TPU 슈퍼팟으로 이런 규모의 모델을 실제로 훈련하는 데 성공하면,이는 AI 연구의‘스케일링 법칙’을 최종적으로 검증하는 사건이 될 것”이라며 “AI 산업 전반에서 AGI(범용인공지능) 경쟁 판도가 완전히 달라질 수 있다”고 전망했다.세미애널리시스도 “9216개 칩으로 구성될 슈퍼팟은 기존 GPU 기반 병렬 서버(DGX 클러스터 등)보다 훨씬 크다”며 “초거대 모델 시대에 유리한 설계”라고 강조했다.

슈퍼팟이 제대로 작동할 수 있게 도울 소프트웨어 역량도 눈길을 끈다.김은지 미래에셋증권 애널리스트는 “TPU 생태계의 숨은 힘은 작스(JAX)·패스웨이(Pathways)·엑스엘에이(XLA)로 이어지는 소프트웨어 스택”이라며 “TPU가 다른 주문형반도체(ASIC)들과 하드웨어 스펙이 비슷해도 효율적인 이유는 컴파일러 등 소프트웨어 덕분”이라고 강조한다.

① 작스는 일종의‘AI 모델 설계 도면’역할이다.개발자가 아이언우드 등 TPU의 복잡한 구조를 몰라도,수학식만 적으면 자동으로 계산 방식을 구성한다.개발자는 오직‘무엇을 계산할지’만 집중할 수 있게 돕는다.② 패스웨이는 컨트롤타워 역할이다.작스를 통해 만들어진 설계도를 바탕으로,이 계산을 구체적으로‘어디서‘어떻게’실행할지 결정한다.③ 엑스엘에이 컴파일러는 작스처럼 프로그래밍 언어로 작성된 코드를 TPU가 이해하고 실행할 수 있는 언어로 번역·최적화한다.엔비디아‘쿠다(CUDA)’와 비슷한 역할로 구글 핵심 소프트웨어다.다만 차이도 분명하다.쿠다는 개발자가 직접 다루는 플랫폼인 반면 엑스엘에이는 자동으로 연산을 최적화하는‘폐쇄형 컴파일러’다.또 번역 방식도 차이가 있다.쿠다는 개발자가 작성한 각 커널(kernel·작업 덩어리) 단위로 코드를 실행하고 엑스엘에이는 통째로 분석한 뒤 재구성하는 형태다.이에 장단점도 분명하다.엑스엘에이는 효율성을 극한으로 끌어올리지만 오류 발생 시‘디버깅(수정 과정)’이 어렵다.어느 부문에서 오류가 발생했는지 확인이 어려워서다.

‘아킬레스건’분명한 TPU

일각에선 아이언우드로 인한 엔비디아 패권 균열을 점친다.하지만 월가는 이를 반박한다.지나친 망상이라는 평가다.조셉 무어 모건스탠리 애널리스트는 “TPU 같은 ASIC가 갖는 위력이 과장되고 있다”며 “엔비디아가 AI 칩 시장에서 지배적인 점유율을 유지할 것”으로 예상했다.

관련 업계에서도 비슷한 시선이 나온다.구글 아이언우드가 지닌 약점 때문이다.아이언우드는 추론 트렌드와 맞지 않는 부분이 있다.아이언우드는 초저정밀도(FP4·FP6) 연산을 지원하지 않는다.AI 추론 시장은‘더 적은 비트’로‘더 빠르게’결과물을 내는 게 핵심이다.문샷 등 차세대 스타트업들이 FP4 기반 서비스 운영을 시작한 배경이다.아이언우드는 FP8까지만 지원한다.반면 엔비디아 블랙웰은 FP4 연산이 가능하다.한종목 애널리스트는 “앞으로 많은 기업들이 FP4 사용을 지향할 것을 보인다”며 “추론 시장에서 구글이 엔비디아 GPU 수요를 생각보다 많이 못 뺏어올 수 있다”고 전망했다.

개발 생태계 진입 장벽도 문제다.엔비디아는 전 세계 400만명 이상의 개발자가 사용 중인 쿠다(소프트웨어 플랫폼)를 보유 중이다.단순 하드웨어만으로는 GPU 지위를 위협할 수 있어도,개발자들의 경험이나 생태계 전환 비용을 고려하면 얘기가 복잡해진다.플랫폼 이동 시 그간 쌓인 라이브러리를 포기해야 하고 해당 플랫폼이 쿠다 수준의 최적화를 보장하는 것도 아니기 때문이다.기업 입장에선 잘 쓰던 쿠다를 버리고 새로운 소프트웨어를 도입하는 것 자체가 리스크인 셈이다.젠슨 황 CEO가 직접 “엔비디아 GPU의 해자(moat)는 쿠다와 NV링크 네트워킹이 구축한 거대한 장벽 덕분”이라고 말할 정도다.

엔비디아와 구글 간 경쟁이‘제로섬 게임’이 아닌 전체 AI 칩 시장 확대 요인이란 분석도 있다.다니엘 뉴먼 퓨처럼 그룹 수석 애널리스트는 “AI 인프라 시장은 향후 수조달러 규모로 성장할 것”이라며 “거대한 판에서 엔비디아·구글은 물론 아마존·퀄컴까지 모두가 수조원 수익을 올리는‘윈-윈(Win-Win)’이 가능하다.제로섬 게임을 걱정하는 건 시장 규모를 간과한 오류”라고 설명했다.이들은 TPU 등 ASIC 진영과 GPU 간 경쟁 심화 → 가격 인하 → 수요 증가 → 전체 시장 규모 확대 논리를 주장한다.

구글도 엔비디아 균열 등에 대해선‘터무니없는 소리’로 받아들이는 모습이다.아미르 야즈단(Amir Yazdanbakhsh) 구글 연구 과학자는 제미나이 3 발표 후 엔비디아 주가 하락을 두고 “(엔비디아에 대한) 매도세는 하드웨어와 (AI 칩 시장) 수요에 대해 시장과 투자자들이 얼마나 무지한지를 보여준다”고 지적했다.

웃는 건 결국‘삼성·하이닉스’

투자자 입장에서 가장 확실한 투자처는 메모리반도체 업체다.GPU뿐 아니라 TPU 역시 고대역폭메모리(HBM)가 필수 탑재되기 때문이다.하나증권에 따르면,아이언우드는 용도(학습·추론)에 따라 5세대 제품(HBM3E) 6~8개를 탑재한다.가파르게 성장 중인 AI 칩 시장 규모를 고려하면 엔비디아와 구글 간 경쟁과 무관하게 삼성전자와 SK하이닉스는‘꽃놀이패’를 쥔 셈이다.

특히 GPU 부문에선 메모리반도체 3사(SK하이닉스·삼성전자·마이크론)가 경쟁했지만 TPU 부문에서는 SK하이닉스·삼성전자 양강 구도가 굳어지는 모양새다.

마이크론의 생산능력(CAPA) 한계 때문이다.구글이 TPU의 내부 활용을 넘어‘외부 판매’를 결정한 만큼 안정적인 부품 수급은 필수 조건이다.하지만 현재 마이크론 생산능력으로는 이를 감당하기 어렵다.엔비디아 등 기존 고객사 물량을 담당하기도 빠듯한 상태다.HSBC에 따르면,마이크론의 웨이퍼 기준 월간 HBM 생산능력은 약 5만5000장이다.삼성전자(15만장)와 SK하이닉스(16만장)의 3분의 1 수준이다.마이크론도 생산능력 확대에 나선 상태지만 시간이 필요하다.

니혼게이자이신문(닛케이)에 따르면,마이크론은 차세대 HBM을 생산하기 위해 일본 히로시마현에 새 공장을 지을 예정이다.내년 5월 착공하고,2028년 HBM 제품을 출하할 예정이다.상황이 이렇다 보니 당장의 구글향 HBM 물량은 SK하이닉스·삼성전자가 양분 중이다.한국투자증권은 올해 구글 TPU 내 HBM 공급 비중을 SK하이닉스 56.6%,삼성전자 43.4%로 추정했다.

김록호 하나증권 애널리스트는 “TPU 등 ASIC는 스펙이 상향되며 고사양,고용량 HBM이 탑재되고 있다”며 “HBM의 수요처가 다변화된다는 측면도 고려해야 한다”고 말했다.그러면서도 “기존 GPU 부문에서 독보적인 지위를 갖고 있던 SK하이닉스 HBM 프리미엄은 고민이 필요한 시점”이라고 덧붙였다.

TPU로 인한 HBM 수요 증가는 범용 D램 부문에도 긍정적 영향을 줄 전망이다.범용 D램 공급 부족이 가팔라질 가능성이 크다.제한된 생산능력에서 HBM 라인을 늘리다 보니 범용 D램 공급 부족이 발생하는 꼴이다.반도체 업계 관계자는 “최근의 HBM 수요 증가 환경은 HBM 자체로도 호재지만 범용 D램 부문 수급 불균형으로 이어질 수밖에 없다”며 “일반 서버 출하량과 D램 채용량 급증으로 범용 반도체 수요가 늘고 있지만 생산라인이 한정된 만큼 공급 증가는 제한적일 것이다.단순한 경제학 이론처럼 수요가 늘고 공급이 정체하면 평균 단가는 오를 수밖에 없다”고 분석했다.

이수페타시스 등 기판株 재평가

TPU에 필요한 핵심 부품을 공급하는 국내 기업들에 대한 시장의 관심이 급격히 높아지며,국내 기판·부품 업체들이 시장의 조명을 받고 있다.대표적인 곳이 이수페타시스다.이수페타시스는 TPU의 핵심 부품인 인쇄회로기판(PCB)을 생산하는 기업이다.국내에서 유일하게 고다층인쇄회로기판(MLB)을 양산해 구글에 납품한다.

특히 시장에서는 지난 6월부터 이수페타시스가 공급을 시작한 아이언우드용 MLB가 당초 계획보다 2배 이상 확대 출하된 점에 주목한다.MLB는 AI 서버에 필수적인 고난도 기판이다.다층 회로를 통해 대량의 데이터를 빠르게 처리할 수 있어 AI 서버와 가속기에 필수적이다.실적도 급성장 국면이다.이수페타시스는 올해 3분기 연결 매출액은 2961억원,영업이익 584억원을 기록했다.지난해 동기 대비 각각 43%,126% 증가했다.

삼성전기도 주목된다.FC-BGA(플립칩 볼그리드어레이) 전망이 밝아서다.FC-BGA는 반도체 칩과 기판을 돌기처럼 동그란 형태 범프로 연결한 인쇄회로기판(PCB)의 한 종류다.차세대 기판으로 정밀한 회로 구현이 가능해‘초정밀 반도체 칩’을 안정적으로 꽂을 수 있다.용도에 따라 대형 기판으로 만들 수도 있다.지금까지 FC-BGA는 이비덴 등 일본 업체가 주도했다.하지만 최근에는 삼성전기도 존재감을 키우고 있다.

삼성전기는 올해 2분기부터 아마존웹서비스(AWS)에 AI 가속기용 FC-BGA를 공급하기 시작했다.AWS는 엔비디아 의존도를 낮추기 위해 개발 중인 자체 AI 칩‘트레이니엄’등에 삼성전기 FC-BGA를 채택했다.삼성전기는 점차 FC-BGA 공급 범위를 브로드컴과 구글 등으로 확대할 가능성이 높다.증권가는 삼성전기의 FC-BGA가 오는 2027년까지 사실상‘완판(솔드아웃)’상태일 것으로 추정한다.

[최창원 기자,조동현 기자 ]

[본 기사는 매경이코노미 제2338호 (2025.12.10~12.16일자) 기사입니다]

[Copyright (c) 매경AX.All rights reserved.무단 전재,재배포 및 AI학습 이용 금지]

누누티비 카지노시즌2,앞서 14명 환자에게 VX-880를 투약하자 13명이 목표했던 당화혈색소 수치를 달성했다.